Анын ичинде бир катар ишканалар Microsoft і Facebook, жада калса Түштүк Калифорния университетинин изилдөөчүлөрү терең фейк менен күрөшүү жана алардын сары медиа жана жалпысынан туура эмес маалымат аркылуу жайылышын алдын алуу үчүн технологияларды иштеп чыгууда. Бирок, бир топ окумуштуулар дагы эле аларды алдаганга жетишти.

Сан-Диегодогу Калифорния университетинин компьютердик илимпоздор тобу ар бир видео кадрга "атаандаш мисалдар" деп аталган киргизүү маалыматтарын киргизүү менен учурдагы терең фейкти аныктоо системаларын алдоо дагы деле мүмкүн экенин эскертти. Окумуштуулар өз жыйынтыктарын өткөн айда онлайн өткөн WACV 2021 Computer Vision конференциясында көрсөтүштү.

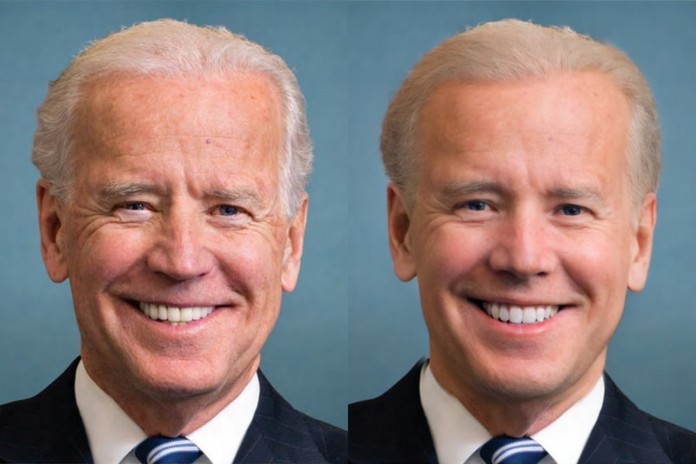

Атаандаш мисалдар машина үйрөнүү моделдери сыяктуу жасалма интеллект системаларынын ката кетиришине себеп болгон бир аз өзгөртүлгөн киргизүүлөр. Кошумчалай кетсек, команда видеону кысылгандан кийин чабуул дагы деле иштей турганын көрсөттү. Жогорудагы видеодо илимпоздор XceptionNet, терең фейк детектору алардын атаандаш видеосун "чыныгы" деп атаганын көрсөтүшөт.

Бул детекторлордун көбү видеодогу жүздөрдү көзөмөлдөө жана кесилген бет маалыматтарын талдоо үчүн нейрондук тармакка жөнөтүү менен иштешет. Нейрондук тармак андан кийин бул маалыматтарды талдап, көбүнчө терең фейктерде начар чыгарылган элементтерди табат, мисалы, жаркылдоо.

Атаандаш мисалдарды киргизүү менен, изилдөөчүлөр бул терең жасалма детекторлорду алдап, видеолордун чыныгы экенине ишенишет.

Алар кагазда мындай деп белгилешет: «Бул терең фейк детекторлорун иш жүзүндө колдонуу үчүн, аларды бул коргоону билген жана атайылап бузууга аракет кылган адаптациялык душманга каршы баалоо маанилүү. Эгерде чабуулчу детекторду толук же жарым-жартылай билсе, биз заманбап тереңдикти аныктоо ыкмаларын оңой эле айланып өтүүгө болорун көрсөтөбүз."

Бул окумуштуулар көрсөткөндөй, жалган маалымат менен күрөшүү үчүн иштелип жаткан автоматташтырылган технологиялар али талапка жооп бербеши мүмкүн.

Ошондой эле окуңуз: